2017百度世界大会上首次展示 AI 语音实时识别翻译

2017百度世界大会已经于2017年11月16日顺利落幕,在本届大会上,百度首次展示了 AI 语音技术在千人级大会应用场景下的实时语音识别翻译功能——是的!就是以前我们都脑补过的 “AI同声传译”呐!

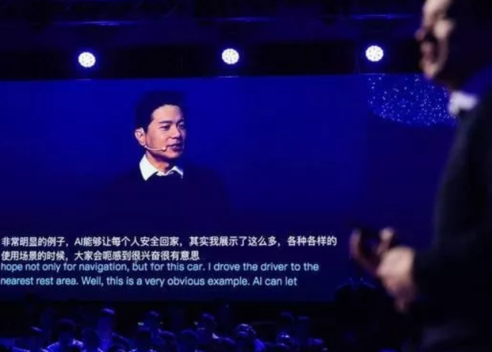

在大会现场,只见一行行中英文随着演讲者的讲话被直接 PO 在了大屏幕上,这样的画面可以说是非常 AI 了 。

现场可以看到,在演讲者进行演讲的同时,两侧的人像投影下方,会有蓝白相间的中英文字幕不断出现、滚动。仔细观察可以发现,中文的上屏速度是跟随演讲者的语速节奏的,也就是说,演讲者如果语速较快,那么文字上屏的内容也很非常快,语速较慢或略有停顿,则文字也相应慢下来;而且全部文字几乎都是在话音刚落便瞬时显示,看不出有任何延迟;而与中文对应的英文翻译则会在中文上屏一个或几个小句后再进行上屏。

“深扒” AI 语音实时识别翻译

因为现场混响或者演讲者偶尔语速较快,有些词句可能现场观众都会听不清,但它也都能够识别出来。甚至演讲者很多口语化的表达,或是混杂着一些英文单词,包括一些非常专业的零部件名称如“高温尼龙玻璃纤维复合材料”都能够被准确识别出来。怎么这么厉害?不光如此,随手摘列这套解决方案的过人之处:

基于演讲领域的海量声学数据,支持快慢语速,支持口语化表达,支持中英文识别

基于会议场景深度定制优化的声学模型及语言模型,能够很好的保证在会场环境下的识别效果

超大规模的语言模型

支持各种垂直场景

超快的响应速度

业界最快的语音解码技术

基于文本的纠错技术,可以做到实时生效,支持各种场景的定制化

基于RNN的标点符号技术

加标点更加智能和自然

┇百度语音识别技术:利用百度规模庞大的基于GPU的深度学习基础设施,百度人工智能实验室团队用新颖的办法在嘈杂环境下建立了一个长达10万小时的语音数据训练集,对这个庞大的数据集采用了端到端的深度学习模型,不仅提升了准确率,还显著减少了代码库的规模。今年百度发布了新一代深度语音识别系统 Deep Speech 3。作为下一代的语音识别模型,它进一步简化了模型,并且可以在使用预训练过的语言模型时继续进行端到端训练。不同场景下轻松部署高精度语音识别模型。

┇百度翻译:在海量翻译知识获取、翻译模型、多语种翻译技术等方面取得重大突破,实时准确地响应互联网海量、复杂多样的翻译请求。所研发的深度学习与多种主流翻译模型相融合的在线翻译系统以及“枢轴语言”翻译等技术,处于业内领先水平,2015年获得国家科技进步二等奖。百度翻译于2015年5月,发布神经网络翻译(NMT)系统,是世界上首个互联网NMT线上产品,支持28种语言756个互译方向;2015年6月,发布手机端离线NMT系统。

准确率95% 完全可代替速记?

本次的世界大会现场,百度董事长兼CEO李彦宏展示了百度大脑让人惊叹的训练成果,谈及现场通过语音识别技术实现的“现场速记+翻译”时,他介绍说,目前百度在会场级的语音识别准确率已经达到了95%,完全可以替代一般的速记工作。

同时,百度也开发出了全球首个基于神经网络的机器翻译(NMT)系统,15分满分的大学英语六级翻译题目,百度翻译可以达到13.6分,远远超过考生的平均水平。现在的机器不仅中文听力碾压人类,而且连外语水平也让人类望尘莫及了。不知道你会不会觉得自己早生了十几年?要是再晚几年,我们还需要学英语吗?

补充一则小亮点,就是一些固定的词汇会在识别完成之后进行特定的展示,如原始的识别结果“AI加雄安”会在一句结束之后变为“AI+雄安”,“usbtypec”会变身为“USB Type-C”,简直是非常智能了。

戳视频感受下这次世界大会现场的实时语音识别翻译:

去年的这个时候,百度大脑“新鲜出炉”,经过亿万级的样本和特征训练,一年之后,已经有了如此多的落地成果。

再过一年,人工智能又将会以怎样的面貌进一步融入我们的生活呢?共同期待吧!